数据处理与存储支持服务 数字化时代的坚实基石

在当今以数据驱动的世界中,无论是企业决策、科学研究还是日常生活服务,高效、安全的数据处理与存储都构成了其核心支撑。数据处理和存储支持服务已不再是简单的后台功能,而是驱动创新、保障业务连续性与竞争优势的战略性资产。本文将深入探讨这一服务的核心内涵、关键技术与未来趋势。

一、核心内涵:从原始数据到价值洞察

数据处理与存储支持服务是一个集成的技术与管理体系,旨在对海量、多源的原始数据进行有效的采集、清洗、整合、存储、计算、分析与归档,最终将其转化为可操作的见解与知识资产。它主要包含两大支柱:

- 数据处理:涵盖数据生命周期的前半程。包括数据接入与采集(从物联网设备、业务系统、互联网等获取数据)、数据清洗与转换(消除错误、标准化格式)、数据集成与建模(将分散数据统一关联),以及近实时或批处理的计算分析。其目标是让“脏数据”变成“干净、可用”的高质量数据。

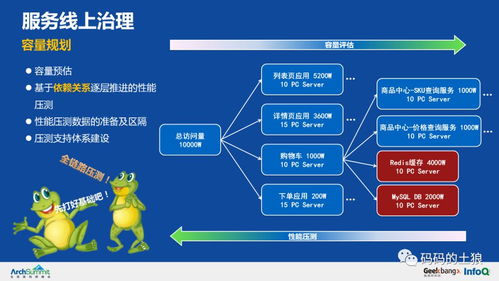

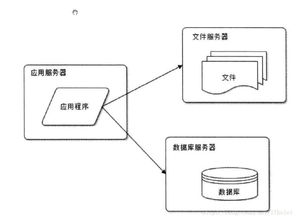

- 数据存储:提供数据持久化保存的解决方案。这需要根据数据的访问频率(热数据、温数据、冷数据)、结构类型(结构化、半结构化、非结构化)、合规与安全要求,设计分层的存储架构。核心是确保数据的安全性、可靠性、可扩展性及在需要时能被高效检索。

二、关键技术支撑

现代数据处理与存储服务依赖于一系列快速演进的技术:

- 云计算与混合架构:公有云(如AWS S3, Azure Blob Storage, 阿里云OSS)提供了近乎无限的弹性存储和强大的计算服务(如Spark、Flink)。混合云与边缘计算模式则满足了数据本地化、低延迟处理的需求。

- 数据库技术的多样化:关系型数据库(如MySQL, PostgreSQL)处理事务型业务,NoSQL数据库(如MongoDB, Cassandra)应对海量非结构化数据,而新兴的云原生数据库(如Snowflake, Google BigQuery)则提供了极佳的分析性能与易用性。

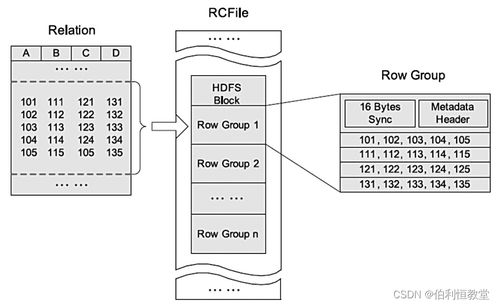

- 大数据与实时处理框架:Hadoop、Spark生态圈依然是批量处理海量数据的基石,而Kafka、Flink等技术则支撑着流数据的实时处理与分析,满足即时决策需求。

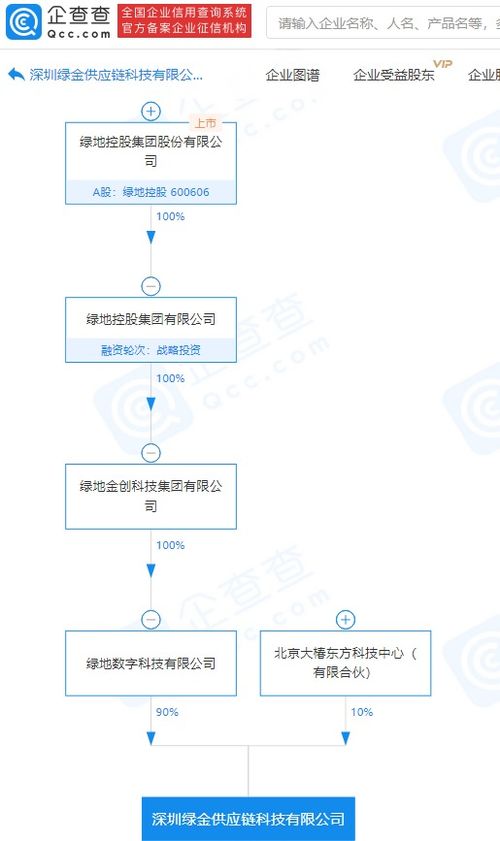

- 数据安全与治理技术:加密(传输中与静态)、访问控制、数据脱敏、审计日志以及数据血缘追踪等技术,共同构筑了数据安全与合规的防线,确保数据资产在可控范围内被使用。

三、服务价值与应用场景

专业的支持服务能为组织带来显著价值:

- 提升决策效率与精准度:通过高效处理与分析,将数据转化为商业智能(BI)报告、预测模型,驱动数据驱动的决策。

- 保障业务连续性:可靠的存储备份与容灾方案,确保关键数据不丢失,业务在故障或灾难后能快速恢复。

- 激发创新与优化体验:为人工智能、机器学习、个性化推荐等前沿应用提供高质量的数据燃料,从而创新产品与服务,优化用户体验。

- 满足合规要求:帮助组织遵守如GDPR、个人信息保护法等数据法规,避免法律风险。

应用场景遍及各行各业:金融风控、电商精准营销、智能制造中的预测性维护、智慧城市的交通管理、医疗健康的数据分析等,无一不依赖强大的后台数据处理与存储能力。

四、未来趋势与挑战

该领域正呈现以下趋势:

- 智能化与自动化:AI和ML将被用于数据管理的各个环节,如自动数据分类、异常检测、性能调优和成本优化。

- 统一与融合的数据平台:打破数据孤岛,构建集数据湖、数据仓库、实时流处理于一体的统一数据平台(Lakehouse架构),简化数据架构。

- 极致实时化与边缘化:随着IoT和5G发展,数据处理将更靠近数据源头,实现更低的延迟和更高的响应速度。

- 数据隐私与安全的强化:差分隐私、联邦学习等技术将在保护用户隐私的前提下,实现数据的协同价值挖掘。

挑战依然存在:指数级增长的数据量带来的成本与复杂度管理、日益严峻的安全威胁、技术人才的短缺以及对数据伦理的深入思考,都是服务提供者与使用者必须共同面对的课题。

###

数据处理与存储支持服务,如同数字世界的“心脏”与“仓库”,其稳健与高效直接决定了整个数字生态的活力。对于任何希望在未来竞争中立足的组织而言,投资并构建一个现代化、安全可靠、灵活可扩展的数据处理与存储支撑体系,已不是选择题,而是关乎生存与发展的必答题。它不仅是技术的堆砌,更是将数据这一新时代的“石油”提炼成高价值“产品”的核心炼油厂。

如若转载,请注明出处:http://www.wqlyp.com/product/32.html

更新时间:2026-05-30 11:24:06